RALI

Note

RALI

- 标题:REASONING AS REPRESENTATION: RETHINKING VISUAL REINFORCEMENT LEARNING IN IMAGE QUALITY ASSESSMENT

- 作者:Bytedance & PKU

- 发表会议/期刊:ICLR

- 年份:2026

- 链接:RALI

Intro

Topic: this paper focuses on the source of generalization of RL-based IQA models (e.g., Q-Insight)

Motivation:

- 引入视觉强化学习的IQA模型,其泛化能力提升背后的原理缺乏系统性分析(尽管已有研究在其他领域探索了强化学习的泛化,但图像质量评估任务中视觉特征的独特复杂性和质量评估的主观性,使得这些发现难以直接迁移)

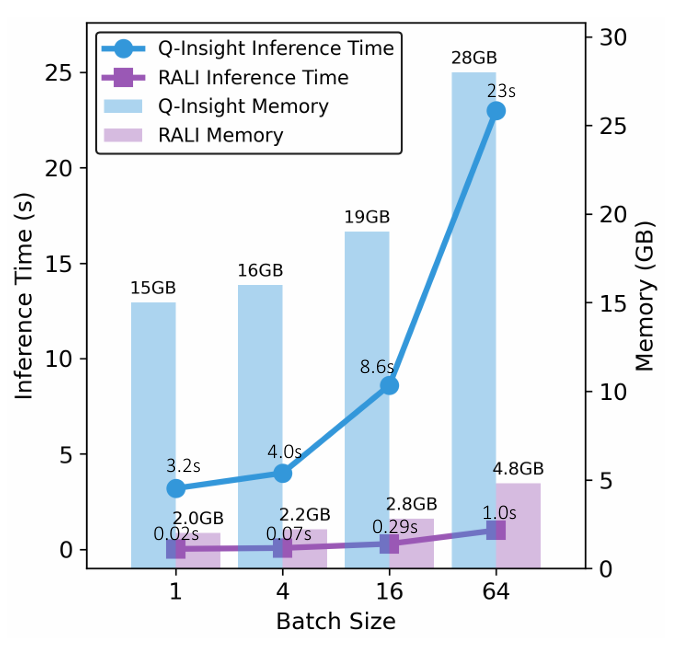

- 逐步推理会带来高延迟和高加载开销,限制了在在线强化学习、移动端和实时场景中的部署

two critical questions(RACT & RALI):

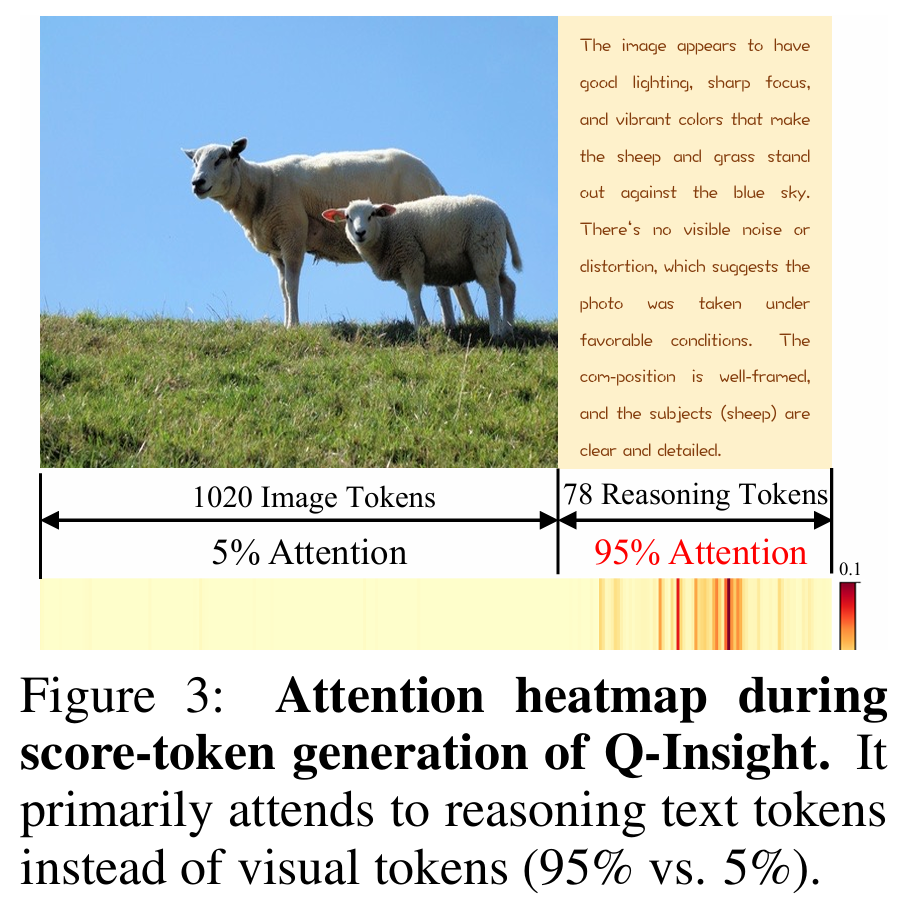

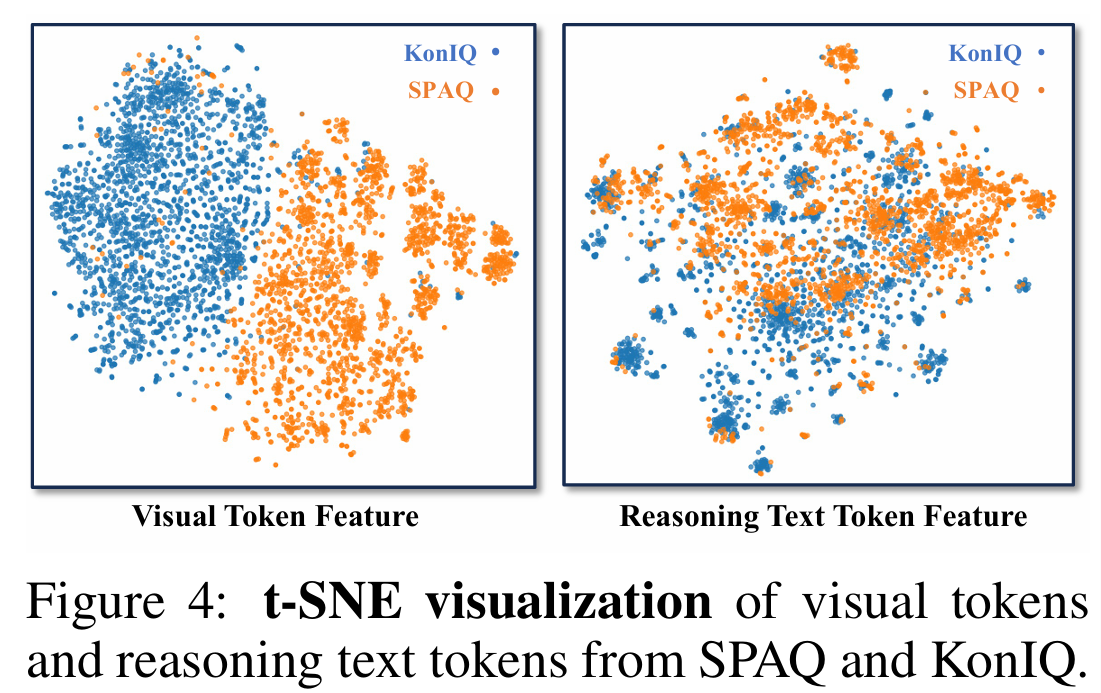

- How is generalization related to reasoning in IQA ?:

- 像 Q-Insight 这样的基于推理的模型不再依赖于冗长的视觉 Token,而是依赖于简洁、紧凑的质量推理文本 Token

- 文本表示可以缓解领域差异

- 推理过程本身,即图像到质量推理文本的转换,与特定数据集的相关性较弱,并且可以在不同领域间保持稳定的对齐

- is it essential?:

- 现有的基于 CLIP 的图像质量评估方法有类似的尝试,但存在两个缺陷:与通用文本的浅层对齐(非质量特定)以及过于简化的文本语料库

- How is generalization related to reasoning in IQA ?:

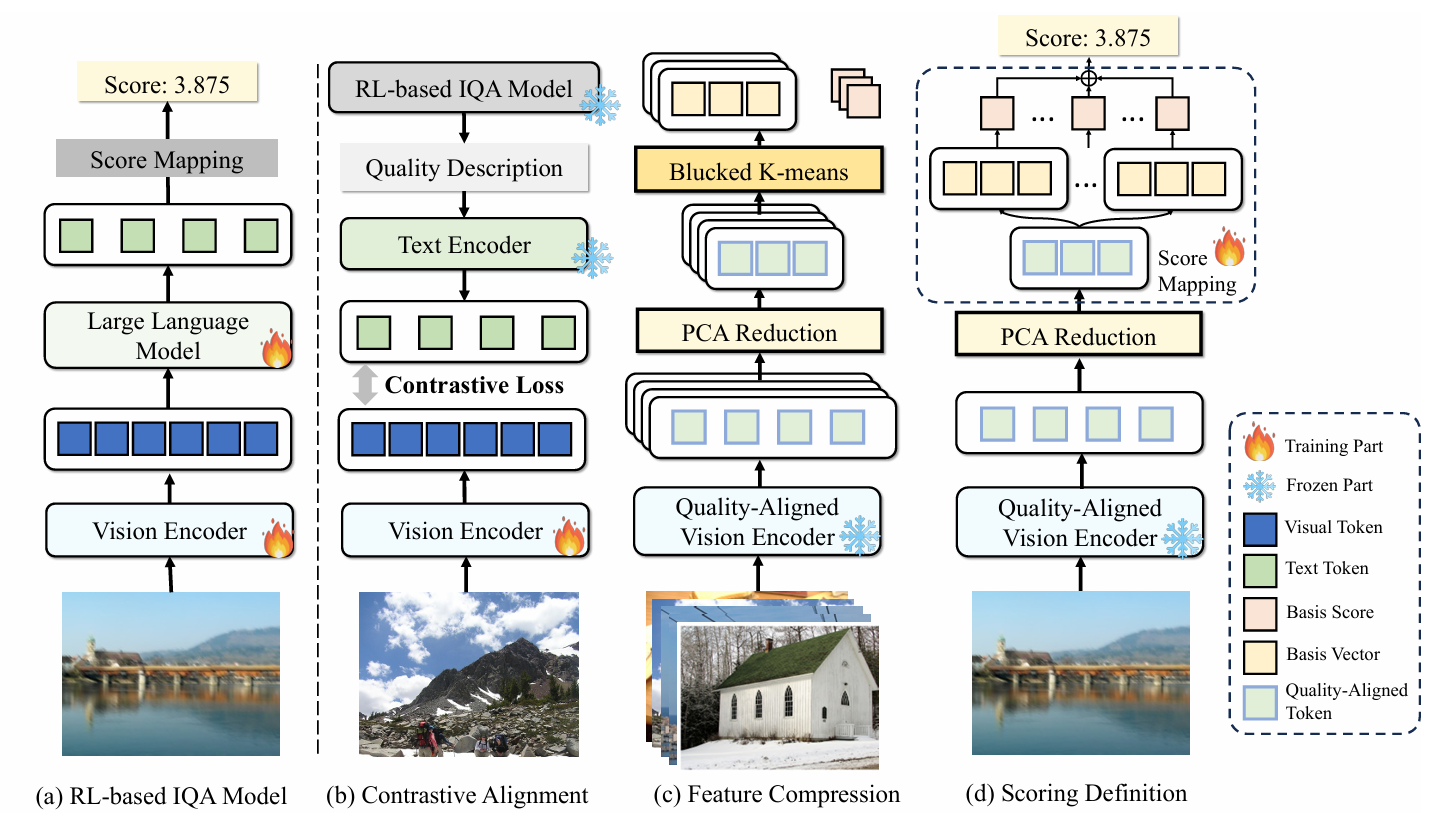

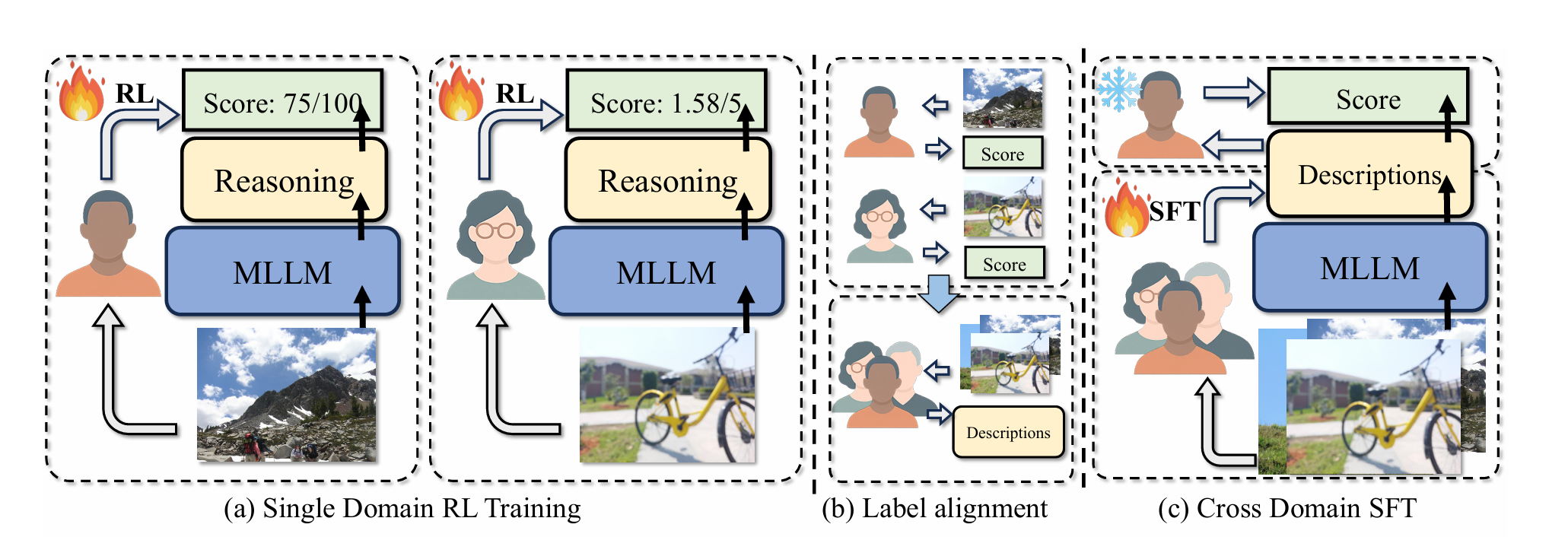

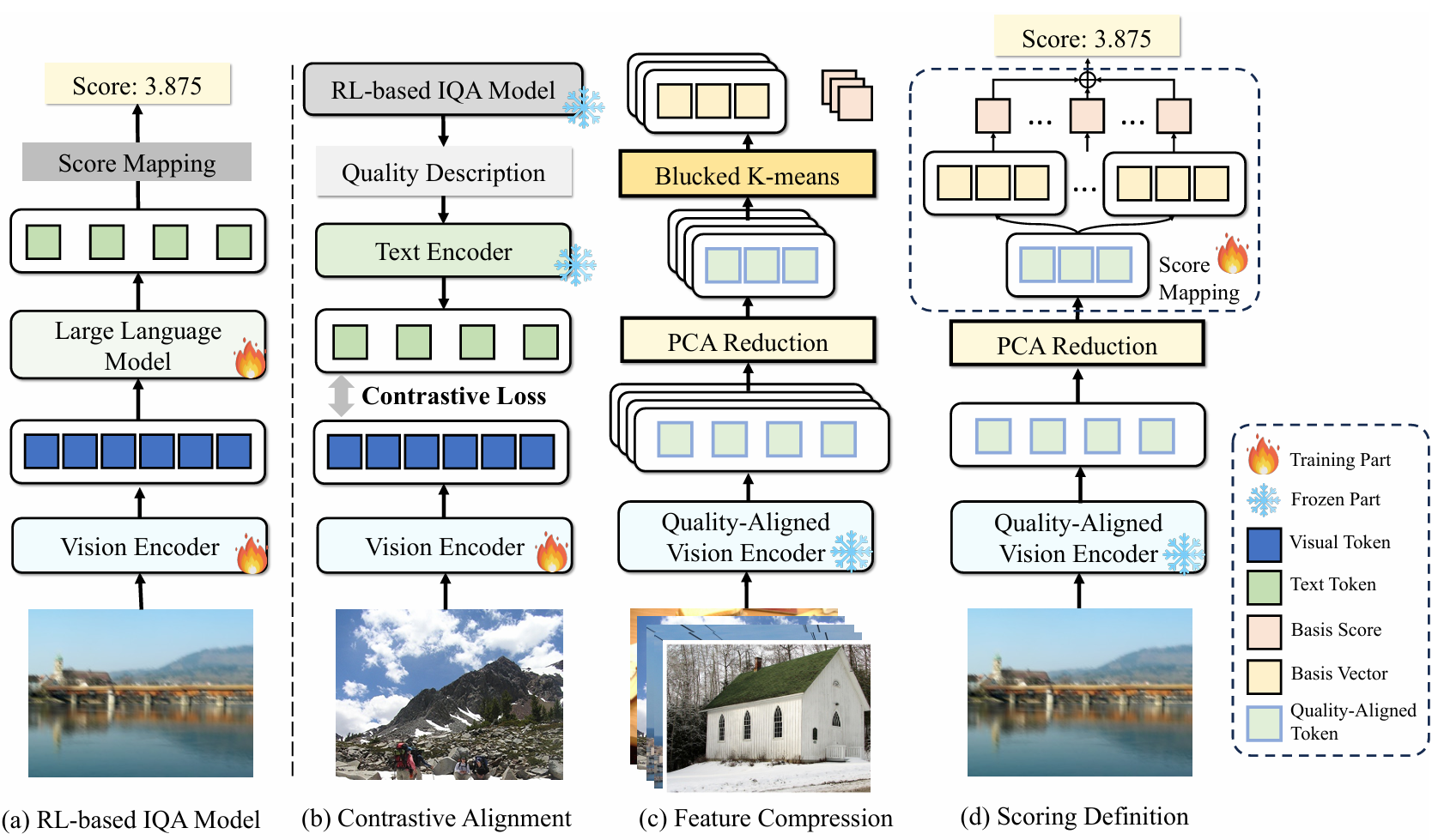

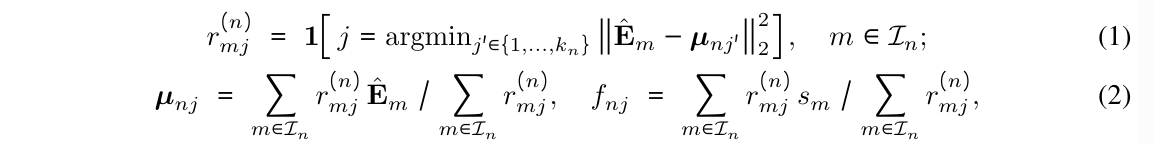

RALI Step:

- 首先,我们通过强化学习获取图像-文本-分数的三元组数据

- 其次,我们通过基于 CLIP 的对比学习将图像与质量推理文本对齐

- 最后,对于文本分数空间,我们利用描述-分数对来定义一个更高维、更精细的分数映射空间

Conclusion:

- 基于推理的图像质量评估模型的泛化能力,其根源在于将视觉信息压缩为文本表示,并且这一发现得到了RACT的进一步证实

- 证明了通过RALI,一种不包含推理过程、也不依赖于大语言模型的框架,可以实现同等水平的泛化能力

Method

Revisiting Reasoning-Based MLLMs in IQA:

通过强化学习,推理模型将其对图像质量评分的依赖从视觉 Token 转移到了推理文本 Token,并且其文本 Token 更简洁,与图像质量更相关。

在表示能力相当的水平下,更紧凑的表示展现出更好的泛化能力,而文本就表现出这种特性。

Answer first question: 强化学习使模型能够获得一种高度可泛化的、从视觉 Token 到文本 Token 的压缩策略, 由于文本 Token 强大的表示能力和泛化性,评分过程展现出优异的泛化能力。

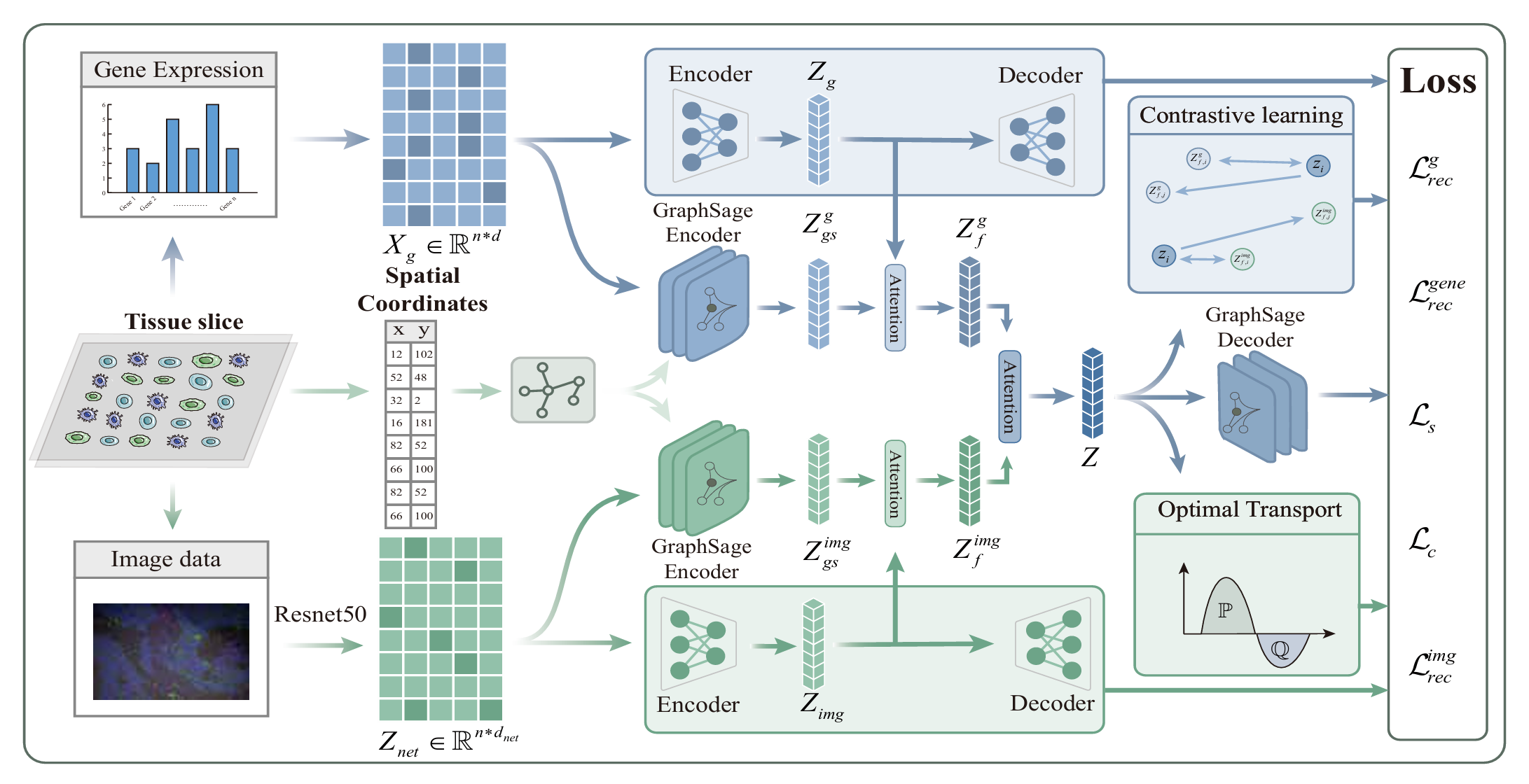

RACT: 推理对齐的跨域训练框架

Reasoning-Aligned Lightweight IQA Framework:

- RALI:

- Contrasive Alignment:

- image–text contrastive learning loss

- 冻结文本编码器,只训练图像编码器

- feature compression:

- scoring definition:

- 以 PCA 和分桶 k-means 的结果作为初始化

- RALI:

Experiments

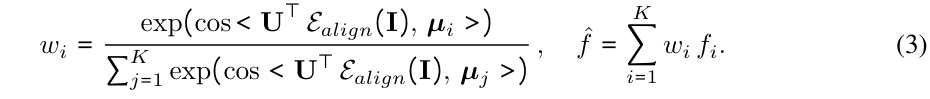

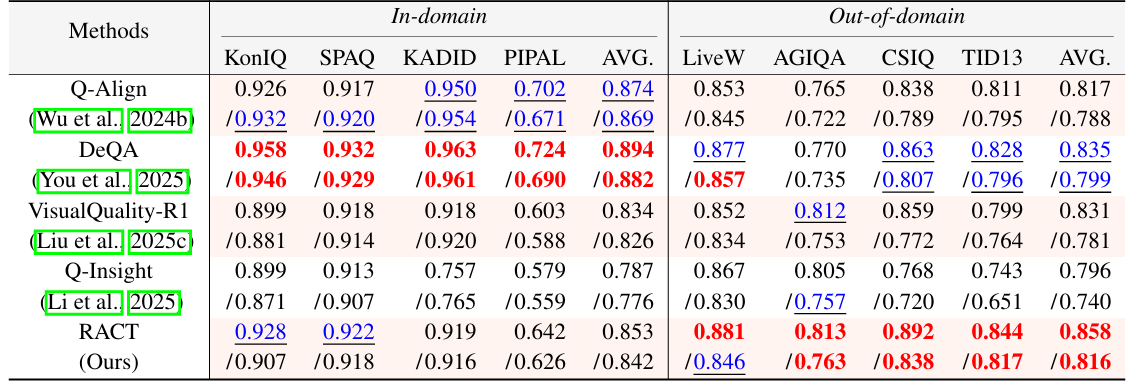

- Results of Score Regression:

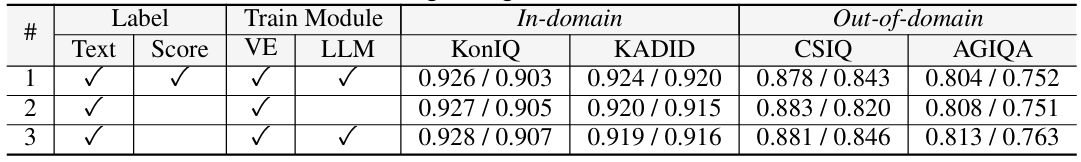

- Results of Single-dataset Training with RALI:

- Results of Multi-dataset Co-training with RACT:

- Results of Single-dataset Training with RALI:

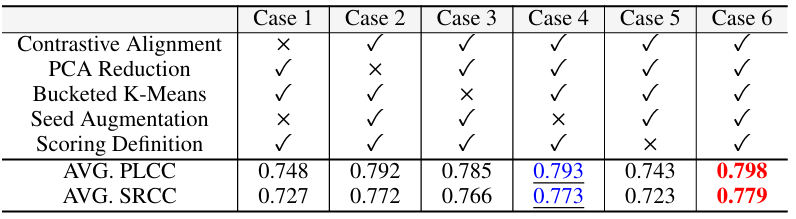

- Ablation Study:

- Ablation on RALI’s Key Components:

- Ablation on Labels and Training Modules in RACT:

- Efficiency Studies of RALI:

- Ablation on RALI’s Key Components:

Conclusion

本文揭示了IQA中推理即语义表示压缩的本质,并据此提出两大框架:RACT通过质量推理文本来对齐跨域数据分布,实现SOTA泛化;RALI则用对比学习完全取代推理,在性能相当的前提下,将参数量与推理开销降低超95%。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 小鱼日记!